CVPR 2025 · Best Paper

VGGT

Visual Geometry Grounded Transformer

視覺幾何基礎 Transformer

REPORTER

蔡書毅

410415032

arXiv 2503.11651 · VGG, Oxford · Meta AI

01/15

目 次

VGGT 簡介

03

Transformer 基礎

07

Transformer 元件拆解

09

ViT 介紹

26

VGGT 架構

27

實驗結果

33

Demo

37

02/15

VGGT 在做甚麼

同一場景的多張視角影像

↓

VGGT

single feed-forward · ~1 sec

↓

Cameras

相機參數

Depth Maps

深度圖

Point Maps

點雲圖

Tracks

點追蹤

03/15

四個輸出的作用例子: Figure 1

1

2

3

4

1

2

3

4

1Cameras

2Point Maps

3Depth Maps

4Tracks

03/15

為什麼要用 VGGT?

方法

年份

10 張影像所需時間

能擴展到 100+ 張?

需要調參?

COLMAP (classical)

2016

約 15 秒

200 張要 ~25 分鐘

要

Hybrid methods

2021

約 10 秒

200 張要 ~10 分鐘

部分要

DUSt3R / MASt3R

2024

約 7 秒

❌ 記憶體爆掉

少量

VGGT

2025

0.2 秒

✓ 200 張只要 9 秒

不用

03/15

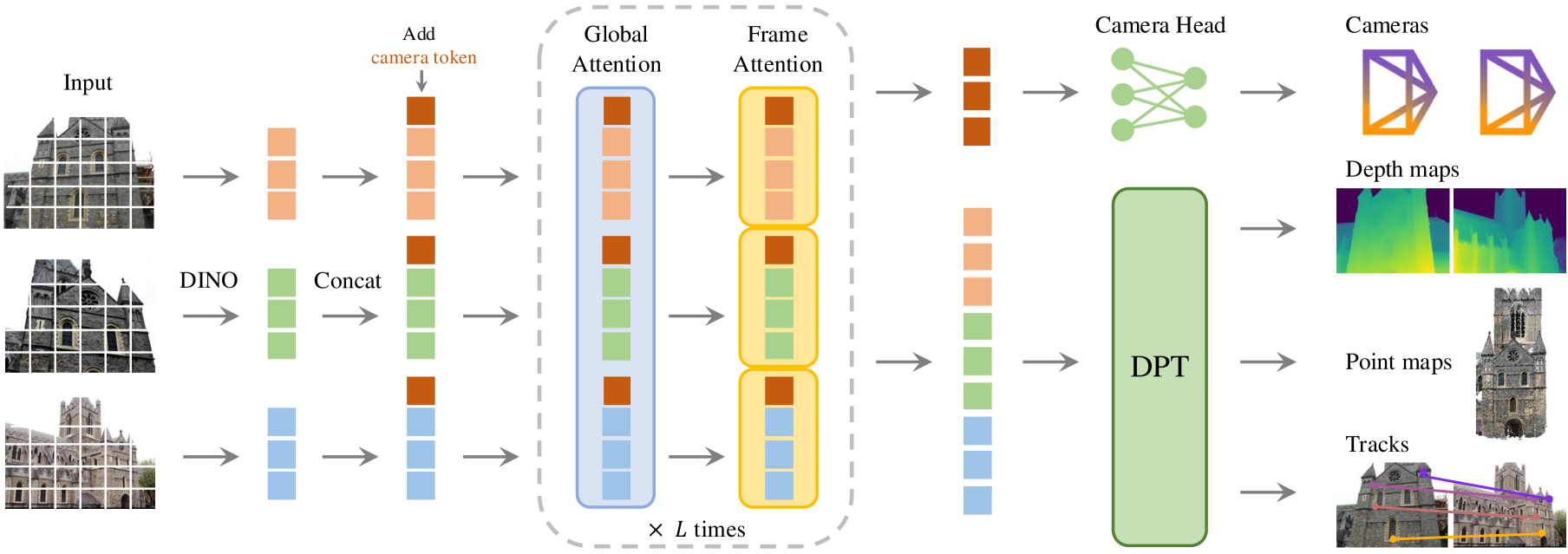

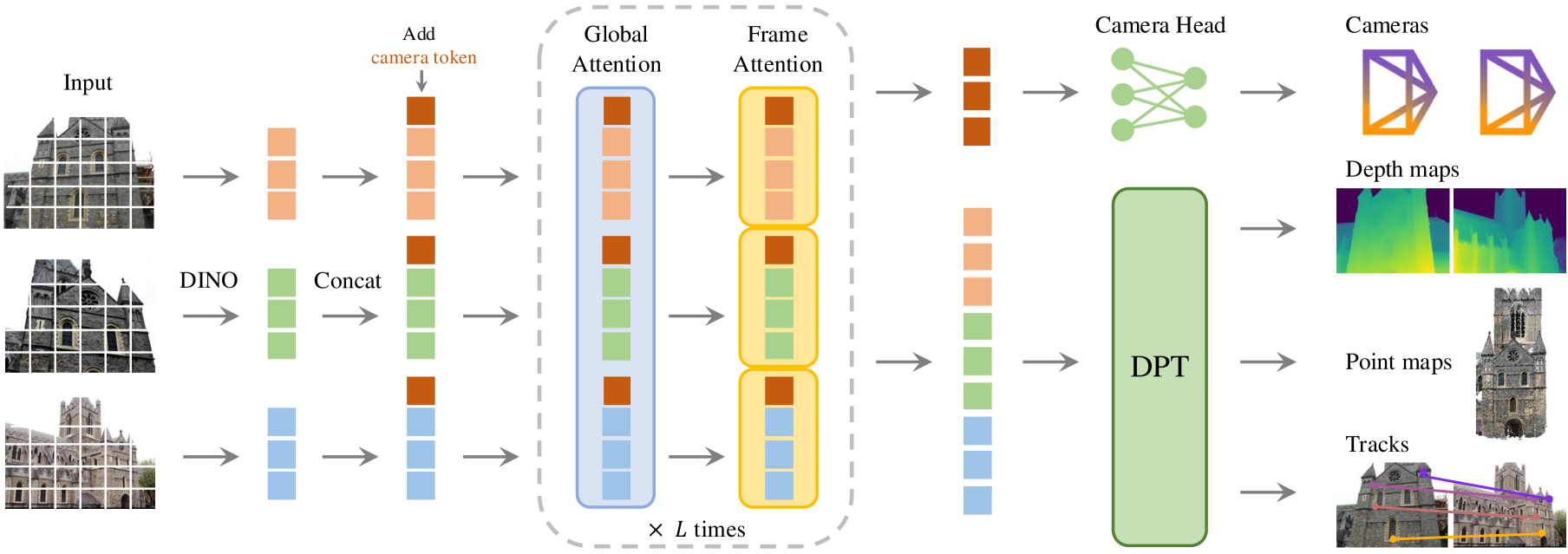

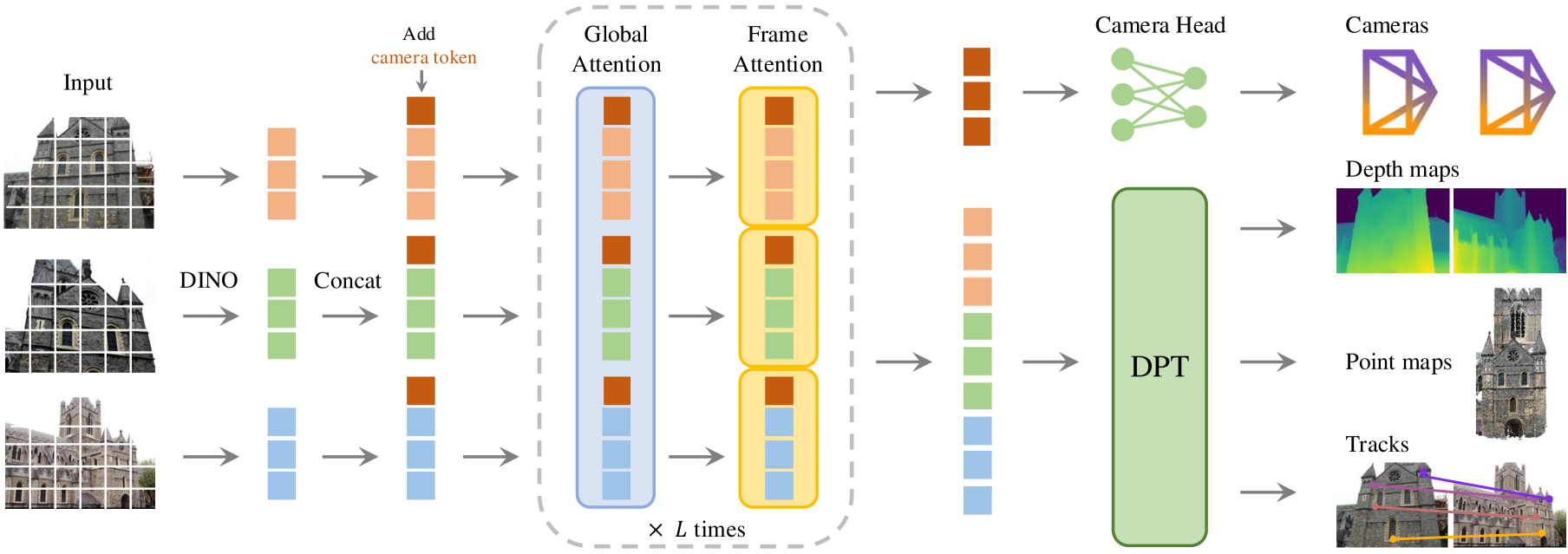

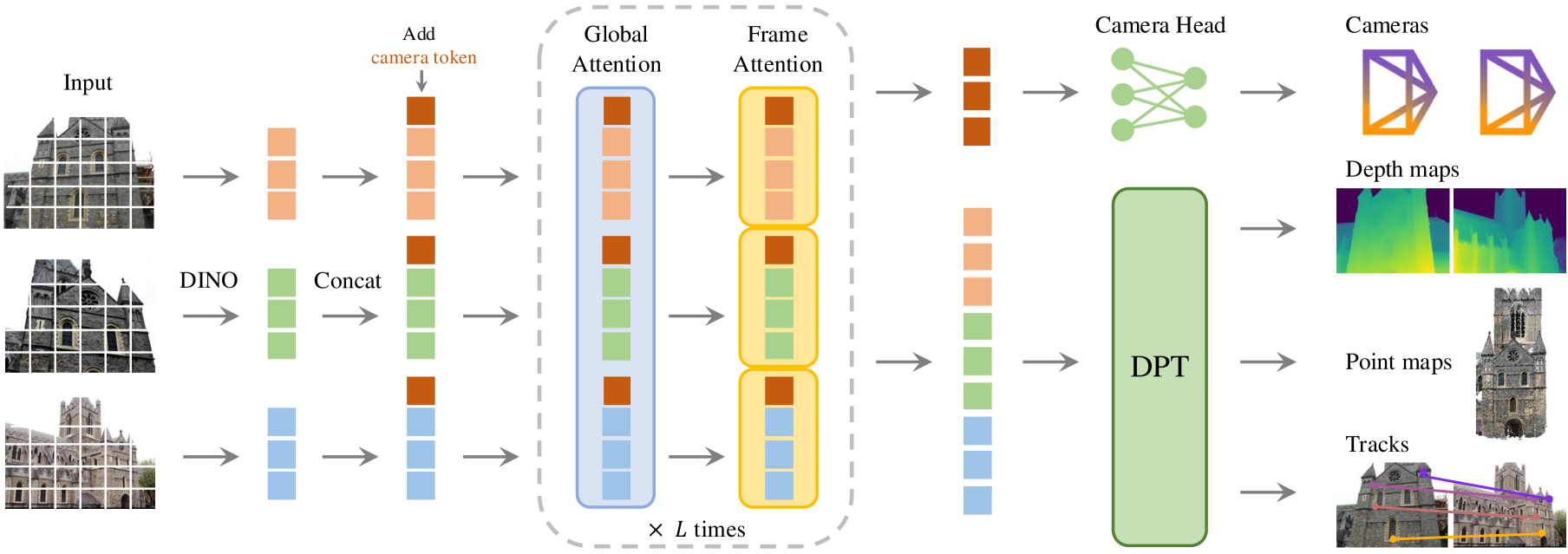

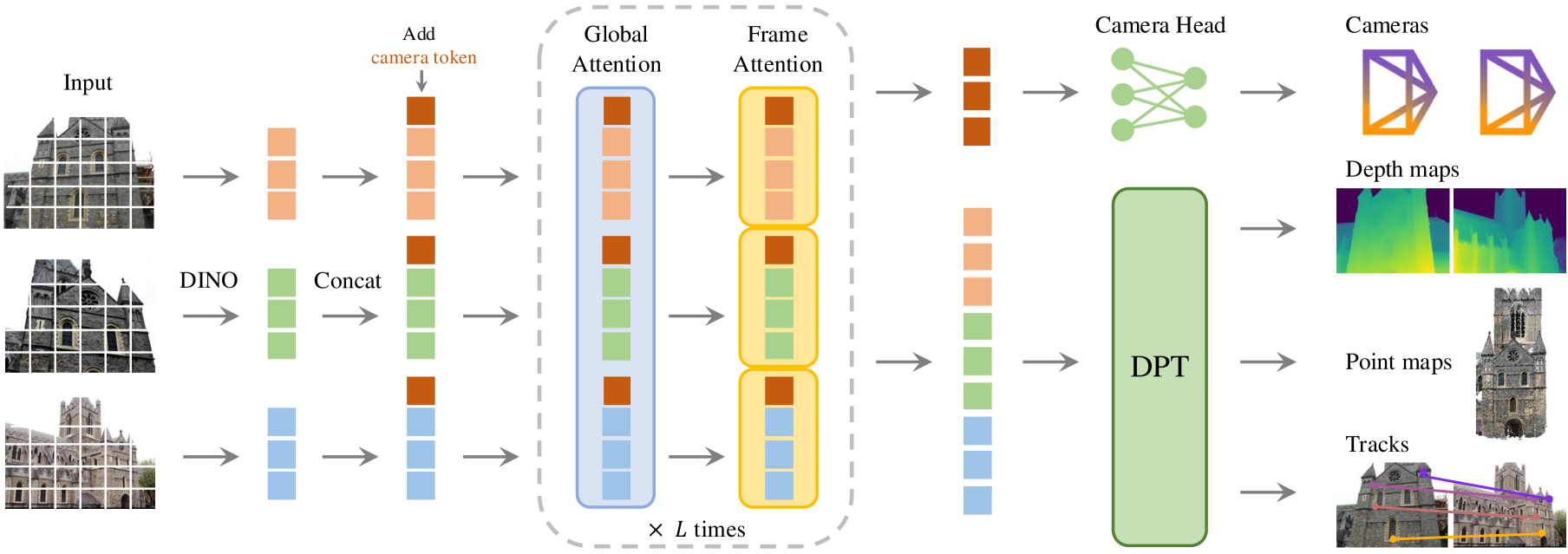

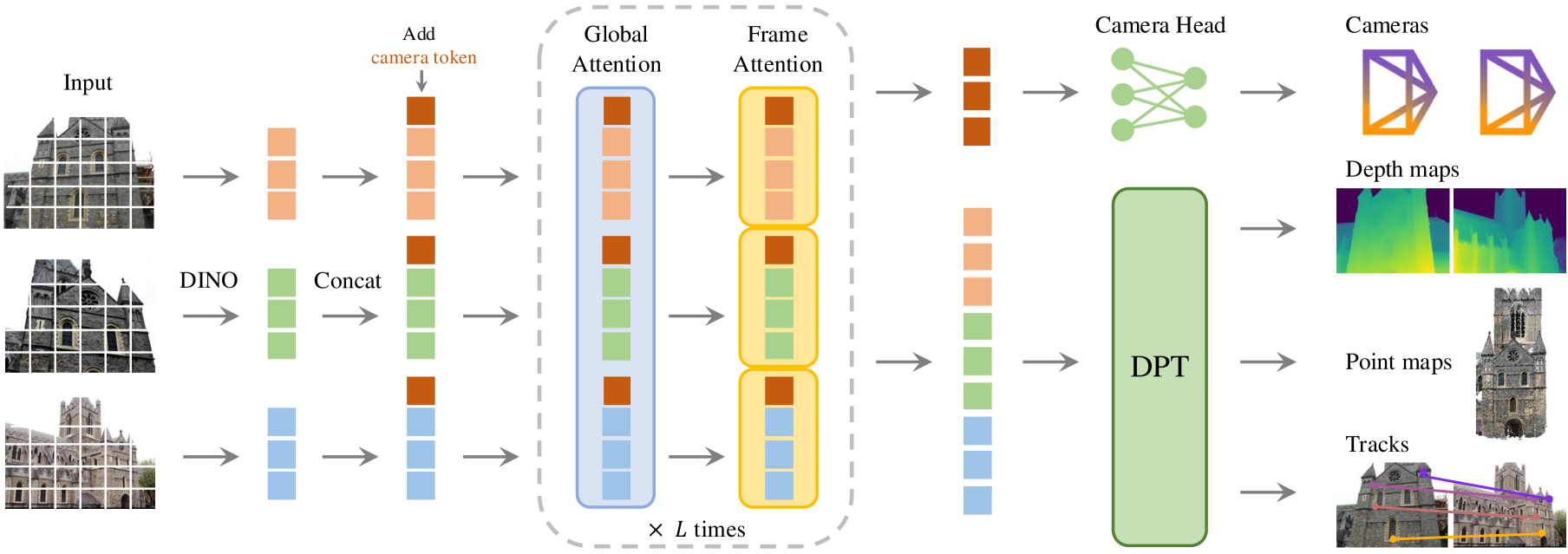

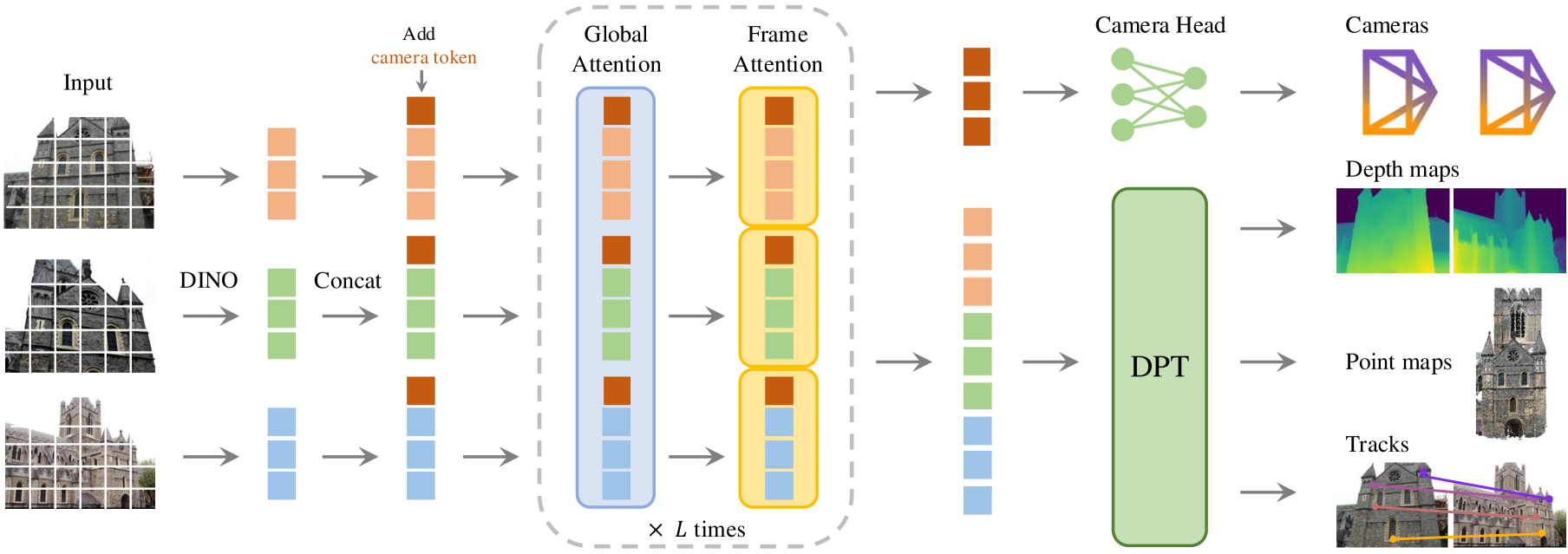

VGGT 整體架構

Transformer

decoder + CNN

03/15

GPT

G

Generative

逐字「產生」新內容

P

Pretrained

海量資料預先學好

VGGT

V

Visual

處理「影像」輸入

G

Geometry

預測「3D 幾何」

G

Grounded

輸出「真實 3D」,非憑空想像

T

兩者共用

Transformer

GPT 與 VGGT 共用的核心架構

04/15

GPT 在做什麼? (文字接龍)

Once

upon

a

↓

↓

下一個 token 的機率分布——從中 sampling:機率越高越可能被選

04/15

Input Embedding

05/15

Tokenization + Input Embedding:從文字到向量

Once

upon

a

time

tokenization

fun

↓

Tokenizer

↓

↓

Input Embedding

↓

05/15

為什麼要用向量? (語意)

boy

+0.30

+0.40

+0.13

−0.07

+0.26

⋮

girl

−0.30

+0.40

+0.10

−0.06

+0.30

⋮

man

+0.30

−0.40

+0.12

−0.05

+0.28

⋮

woman

−0.30

−0.40

+0.11

−0.04

+0.31

⋮

05/15

Positional Encoding

06/15

為什麼需要 Positional Encoding?

句子 A:

The

cat

ate

the

fish

句子 B:

fish

the

ate

cat

The

06/15

加上 Positional Encoding

The

0.20.90.4⋮

cat

0.70.10.5⋮

ate

0.30.60.2⋮

the

0.20.90.4⋮

fish

0.80.30.6⋮

VGGT 不知道誰先誰後

The

0.21.90.4⋮

cat

1.50.61.3⋮

ate

0.11.50.9⋮

the

0.90.81.4⋮

fish

1.60.00.7⋮

VGGT 現在讀得出每個位置

06/15

Attention

07/15

為什麼需要 Attention?

The dog chased the cat until it got tired.

07/15

每個詞分到多少注意力

07/15

Attention:每個詞吸收上下文

07/15

Add & Norm

08/15

Add: 殘差連線

08/15

Feed-Forward Network

09/15

Feed-Forward Network (MLP)

把 attention 收集到的上下文「記住」並「重新理解」

09/15

Linear + Softmax 輸出層 — 投影 + 機率

10/15

Linear + Softmax 經典 MLP 多元分類

10/15

Linear + Softmax 預測下一個詞

▢

10/15

ViT (Vision Transformer)

輸入影像

→

flatten +

linear projection

linear projection

patch1

0.21-0.050.84⋮0.13

patch2

-0.180.420.07⋮-0.31

patch3

0.55-0.27-0.11⋮0.46

⋯

patch256

0.080.33-0.49⋮0.22

↓

↓

類別機率分布——選機率最高的當預測:

cat

0.82

tabby cat

0.09

dog

0.04

fox

0.03

rabbit

0.02

11/15

VGGT 架構 — DINO

DINO = ViT,只取 features

12/15

VGGT 架構 — Add Camera Token

12/15

VGGT 架構 — Global + Frame Attention

Global Attention

Frame Attention

12/15

VGGT 架構 — Camera Head

Why attention blocks?

| Component | Numbers | Type |

|---|---|---|

| Rotation (quaternion q) | 4 | Extrinsic |

| Translation (t) | 3 | Extrinsic |

| Field of view (f) | 2 | Intrinsic |

| Total | 9 |

12/15

VGGT 架構 — DPT Head (Decoder)

input image

→

Encoder

壓縮成抽象 features

→

+0.42−0.18+0.71⋮+0.05

features

→

Decoder

還原成具體輸出

→

reconstructed image

12/15

VGGT 架構 — DPT 在這裡做什麼?

Input

Patch tokens

來自 backbone(每張影像一組)

→

DPT Head

Decoder

→

Depth maps

→

Point maps

→

Tracking features

12/15

準確度 SOTA

相機位姿Camera Pose

RealEstate10K · AUC@30 (↑)

78.9

→

85.3

+6.4

多視角深度Multi-view Depth

DTU · Overall accuracy (↑)

0.71

→

0.86

+0.15

點雲估計Point Map

ETH3D · Recall @ 5 cm (↑)

75.2

→

84.8

+9.6

影像配對Image Matching

ScanNet · AUC @ 5° (↑)

24.8

→

33.9

+9.1

13/15

速度 SOTA

方法

10 張

50 張

100 張

200 張

COLMAP

~15 秒

~3 分鐘

~10 分鐘

~25 分鐘

Hybrid methods

~10 秒

~1 分鐘

~3 分鐘

~10 分鐘

DUSt3R / MASt3R

~7 秒

~30 秒

❌ OOM

❌ OOM

VGGT

0.2 秒

1.5 秒

3 秒

9 秒

13/15

通用性 SOTA

任務

之前的最佳方法

現在最佳

相機位姿Camera Pose

VGGSfM

VGGT✓

多視角深度Multi-view Depth

GeoMVSNet

VGGT✓

點雲估計Point Map

DUSt3R

VGGT✓

影像配對Image Matching

RoMa

VGGT✓

13/15

獎項 SOTA

CVPR 2025

Best Paper Award

電腦視覺領域的最高榮譽

13/15

VGGT demonstration

14/15

感謝聆聽

Q and A

歡迎提問與討論

15/15